- TOP

- 製品情報

- トラッキングシステム

- MoCap Suit

- MOXI V100-R

製品情報

MOXI V100-R

高精度なロボット動作トレーニング&VLA対応ソリューション

正確な運動学、トレーニング駆動、制御と性能の最適化を実現

—世界中のイノベーターから信頼されています。

- 製品概要

製品概要

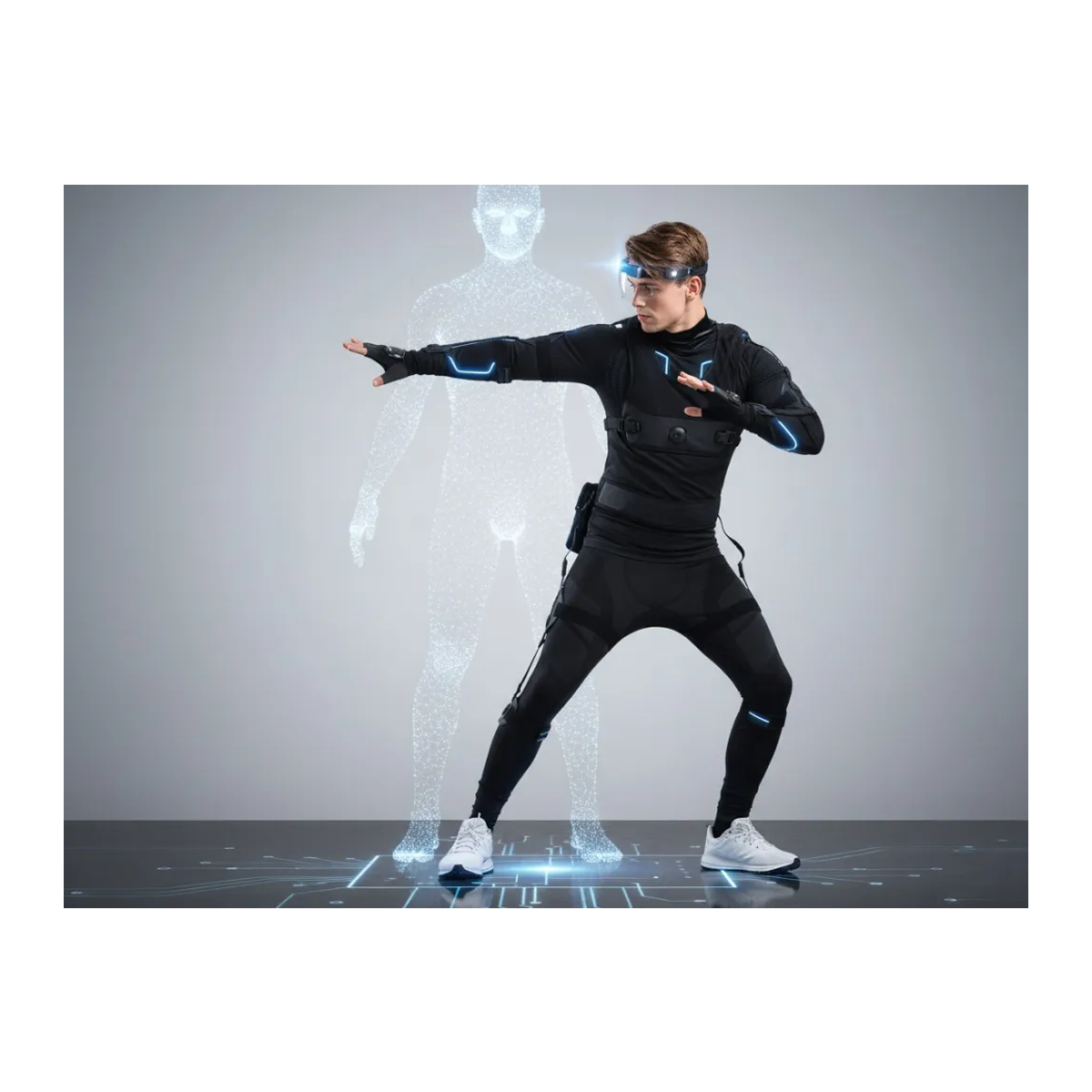

V100-Rは、MOXIが提供する最先端のIMUモーションキャプチャシステムで、人型ロボットの遠隔制御およびVLAトレーニングに特化しています。

自社開発の9軸IMU姿勢融合技術、特許取得済みのダイナミック姿勢補正アルゴリズム、ROS2 SDKを統合し、NVIDIA JetsonプラットフォームおよびROS2エコシステムに迅速に対応可能。

開発者はV100-Rスーツとモーションキャプチャグローブを装着するだけで直感的にロボット用トレーニングデータを生成でき、リアルタイムのモーション模倣、シミュレーションによるトレーニング、データドリブンなモーション学習を実現。プロトタイプ設計から産業応用までの開発スピードを飛躍的に加速します。

IMUモーションキャプチャとして業界をリードし、トレーニング効率を最適化。スマート製造、人–機コラボレーション、エッジAIアプリに最適です。

なぜMOXIのV100-Rを人型ロボットのトレーニングに選ぶのか?

科学的に裏付けられた高精度データ

- 15基の9軸IMUセンサーと高精度フィンガーモジュールを搭載し、全身360°のモーショントラッキングを実現。

- データ精度:RMS誤差1°未満、更新レート100Hz、伝送遅延5ms。スムーズで信頼性の高いAI/MLトレーニング入力を保証します。

- 視線制約なし:従来のRGB-DやLiDARシステムとは異なり、照明条件、遮蔽、金属環境の影響を受けず、常に安定した動作を提供します。

開発環境へのシームレスな統合

- 専用ROS2 SDK:NVIDIA Isaac ROSプラットフォームとのROS2統合に対応し、ロボットのトレーニングおよび開発を加速します。

- NVIDIAエコシステム互換性:OmniverseおよびIsaac Simと完全互換。デジタルツインのモデリング、バーチャルトレーニングシナリオの生成、

シミュレーションテストを実現します。 - エッジAI推論:NVIDIA Jetsonプラットフォーム向けにTensorRTで最適化。リアルタイムの動作解析と制御を実行可能。オフライン環境でもIMUベースのモーションキャプチャをローカル処理でサポートします。

- 標準データ出力:TF、Joint State、IMUデータの出力に対応。URDFモデルおよびRVizやTF Viewerなどの可視化ツールをフルサポートします。

スケーラブルで迅速に導入可能

- マルチユーザー対応:1台のホストで最大5人まで同時トラッキングが可能。スムーズなチームコラボレーションを実現します。

- モジュール式・スケーラブルなアーキテクチャ:高精度なモーションデータライブラリを備え、AIトレーニングやバイオミメティックロボット制御に

最適です。

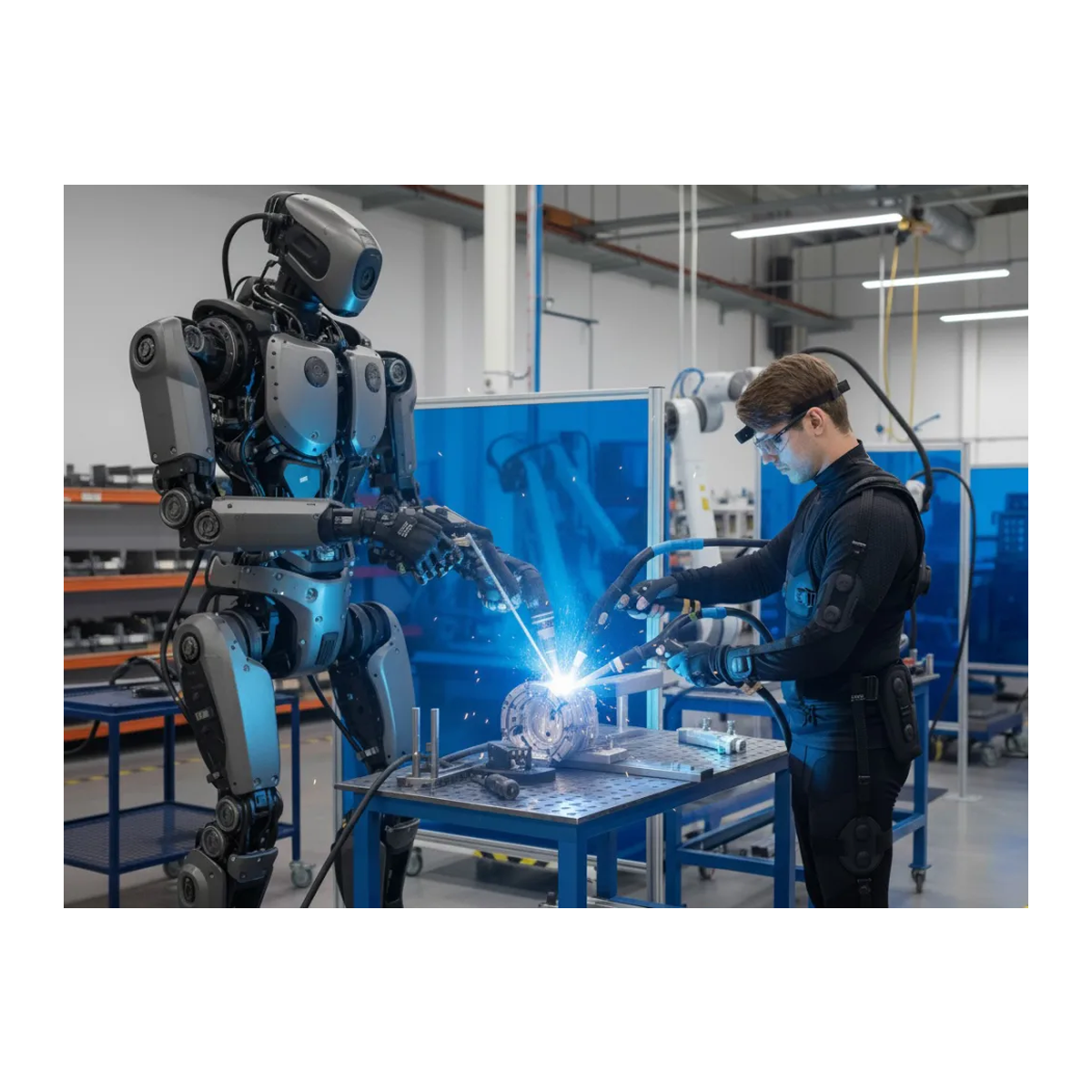

実務での応用価値

- スマート製造:手作業のワークフローをIMUデータセットに変換し、ロボット学習の基盤として活用可能。

- 人–ロボット協働トレーニング:模倣学習、姿勢分類、転倒予測をサポート。

- 危険環境作業の代替:データ駆動型ロボットにより、高リスクまたは専門性の高い作業を安全に実行可能。

- AI・XR研究:デジタルツインモデリング、シミュレーションテスト、インタラクティブアプリケーションまで幅広くサポート。

- モーション駆動型制御:MoCapによる姿勢データを制御信号に変換し、バイオミメティックロボットやロボットアームを駆動。シミュレーション

→トレーニング→実装までをシームレスに実現し、デジタルツインと制御の統合をフルサポート。 - AI強化型知覚:人間の関節データをリアルタイムで提供し、転倒予測や姿勢分類などのトレーニング・推論に活用可能。低遅延のエッジデバイス上でも、AIモデルによりタイムリーかつ精度の高い動作情報を提供。

V100-RのROS2 SDKは現在開発中であり、ROS2標準を優先的にサポートし、NVIDIA JetsonおよびIsaac Simエコシステムとの高い互換性を備えています。私たちはROS2機能を

積極的に強化するとともに、多様なロボット開発ニーズに対応するために、限定的なROS1互換性の検討も進めています。

最新の開発状況については、ぜひ直接お問い合わせください。

MOXI R100-Vを使ったロボット訓練の流れ

1. オペレーターがR100-Vスーツを着用し、ロボットの動作を

リアルタイムで制御。高精度なモーションデータを取得します。

↓

2. 遠隔操作中、ロボットはセンサー情報を収集し、動作や環境の

理解を深めます。

↓

3. モーションデータとセンサーデータを統合することで、AI駆動の

深層学習によりロボットの動作パターンを最適化。

↓

4. AIによる洞察を活用し、ロボットは多様な条件下で自律的に動作を

学習・実行します。

主な活用事例

-

スマート製造

オペレーターの作業フローをIMUアクションデータに変換し、

ロボットの学習に活用。 -

人–ロボット協働トレーニング

融合された9軸IMUデータを活用し、より正確な姿勢情報と

模倣学習を実現。 -

危険・専門環境の代替

モーションデータを用いて、高リスクまたは高度な作業を

ロボットが安全に遂行。 -

AI・XR研究

デジタルツインモデリング、シミュレーション検証、

没入型インタラクティブシナリオなどの応用をサポート。

ビジネス戦略と産業応用

| ビジネス側面 | 戦略的ポジショニング | ターゲット産業 / 応用シナリオ | 産業優位性と価値提案 |

|---|---|---|---|

| 産業内での役割ポジショニング | 「モジュール化された人体動作入力インターフェース」 → IMU MoCap出力を制御・学習ワークフローにシームレスに統合 |

ヒューマノイドロボット開発、 AIトレーニングプラットフォーム |

通用性が高く、ウェアラブルかつ低コストの実体動作入力ソリューションを提供し、 Jetson / ROS2 / Isaacとのクロスプラットフォーム統合に優れる |

| 技術ライセンス & SDKサービス | Isaac Sim / Jetsonと統合可能なROS2 SDKを提供 | ロボットハードウェア・ソフトウェア開発者、 OEM/ODMパートナー |

サードパーティ製品にIMUベースの制御機能を迅速に統合させ、 OEM/ODMの新たなビジネス機会を創出 |

| トレーニングデータ協力 | AIモデル訓練やバイオミメティック学習(模倣学習)に用いる 高精度の人体動作データセットを提供 |

AI研究機関、 ロボットトレーニングプラットフォーム |

信頼性の高いラベル付き「人体動作データ」を提供し、 デジタルツイン、自律制御モデル、リアルなバイオミメティック学習に最適 |

| 標準ソリューション推進 | 「MOXI + Jetson/ROS2」標準開発キットを提供 | 開発者コミュニティ、 産業試作・検証 |

開発ハードルを下げ、迅速なプロトタイピングとデプロイを可能にし、 ブランド認知度とコミュニティ採用を拡大 |

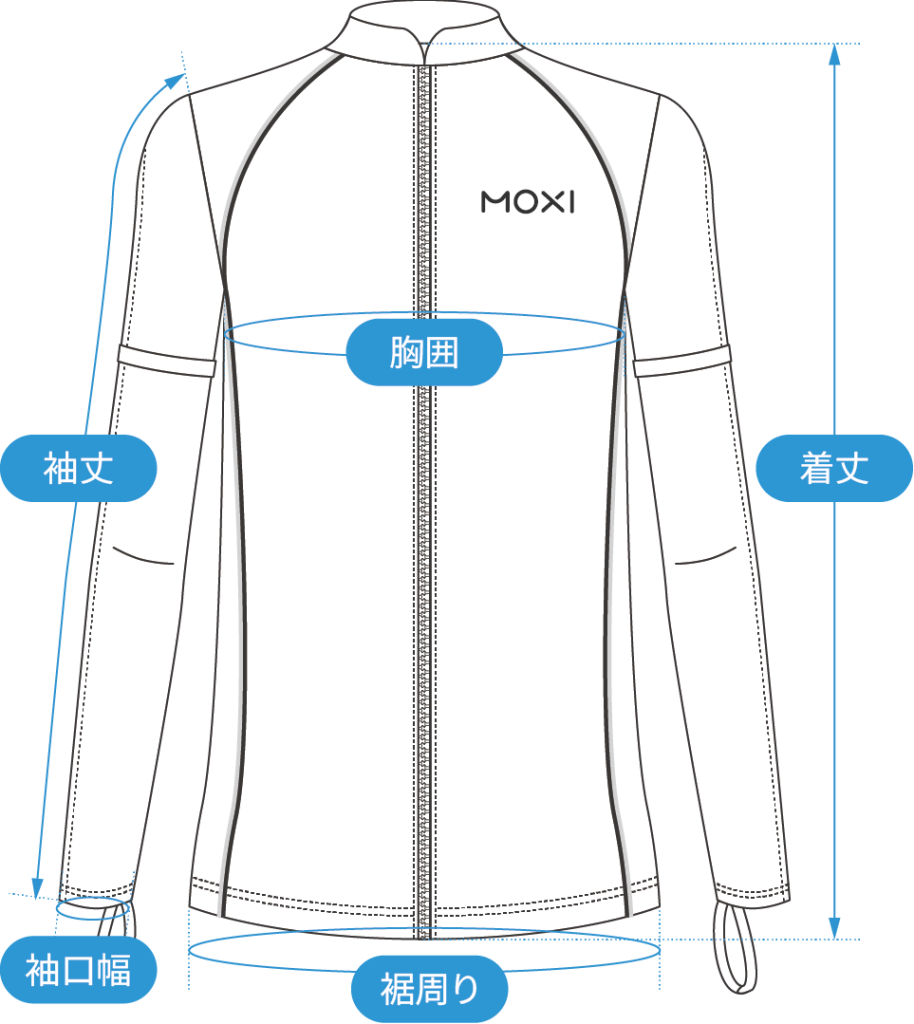

S100 トップサイズ

| 男性用 | 女性用 | ||||||||

|---|---|---|---|---|---|---|---|---|---|

| S | M | L | XL | XXL | S | M | L | XL | |

| 着丈 | 69 | 70 | 71 | 72 | 74 | 61 | 63 | 64 | 65 |

| 胸囲 | 86~104 | 91~110 | 97~116 | 102~122 | 107~128 | 74~88 | 79~94 | 84~101 | 89~107 |

| 裾周り | 81~98 | 86~104 | 91~110 | 97~116 | 102~122 | 71~85 | 76~91 | 81~98 | 86~104 |

| 袖丈 | 59 | 60 | 61 | 62 | 63 | 58 | 59 | 60 | 61 |

| 袖口幅 | 16 | 17 | 18 | 20 | 21 | 16 | 17 | 18 | 20 |

(単位:cm)

最高のパフォーマンスと精度のために、体にぴったりとフィットするサイズをお勧めします。

最適なサイズを見つけるために、以下のガイドをご参照ください。

男性の方へ:

- 胸囲が90cmで、薄手の体にフィットするインナーを着用される場合は、Sサイズをお勧めします。

- もし、少し厚手のベースレイヤーを着用される予定の場合は、Mサイズへのサイズアップをご検討ください。

注記:個人の好みや正確な身体測定値には差があります。センサーが正しく機能するためには、スーツが体にぴったりとフィットしていることをご確認ください。

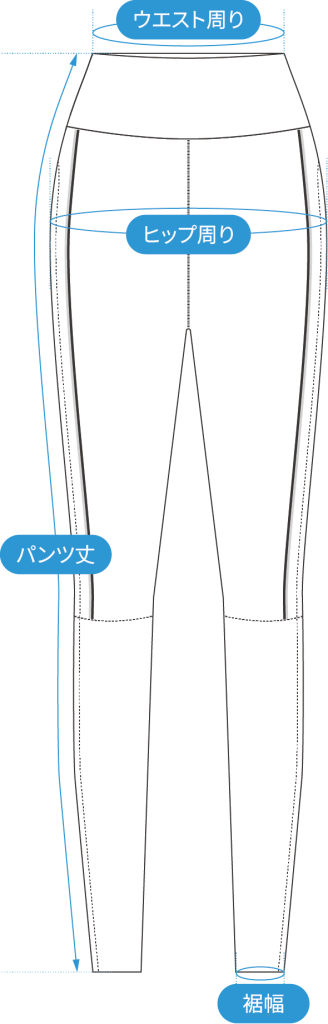

S100 パンツサイズ

| 男性用 | |||||

|---|---|---|---|---|---|

| S | M | L | XL | XXL | |

| ウエスト周り | 73~88 | 78~94 | 83~100 | 86~106 | 93~112 |

| ヒップ周り | 81~98 | 86~104 | 91~110 | 97~116 | 102~122 |

| パンツ丈 | 97 | 99 | 100 | 102 | 104 |

| 裾幅 | 20 | 22 | 23 | 24 | 25 |

| 女性用 | ||||

|---|---|---|---|---|

| S | M | L | XL | |

| ウエスト周り | 59~71 | 64~77 | 69~83 | 74~89 |

| ヒップ周り | 72~87 | 77~93 | 83~99 | 88~105 |

| パンツ丈 | 89 | 90 | 92 | 93 |

| 裾幅 | 19 | 20 | 22 | 23 |

(単位:cm)